# 前言

本項目使用了EcapaTdnn模型實現的聲紋識別,不排除以後會支持更多模型,同時本項目也支持了多種數據預處理方法,損失函數參考了人臉識別項目的做法PaddlePaddle-MobileFaceNets ,使用了ArcFace Loss,ArcFace loss:Additive Angular Margin Loss(加性角度間隔損失函數),對特徵向量和權重歸一化,對θ加上角度間隔m,角度間隔比餘弦間隔在對角度的影響更加直接。

源碼地址:VoiceprintRecognition-Pytorch(V1)

使用環境:

- Python 3.7

- PaddlePaddle 1.10.2

模型下載¶

| 模型 | 預處理方法 | 數據集 | 類別數量 | 分類準確率 | 兩兩對比準確率 | 模型下載地址 |

|---|---|---|---|---|---|---|

| EcapaTdnn | melspectrogram | 中文語音語料數據集 | 3242 | 0.9682 | 0.99982 | 點擊下載 |

| EcapaTdnn | spectrogram | 中文語音語料數據集 | 3242 | 0.9690 | 0.99982 | 點擊下載 |

| EcapaTdnn | melspectrogram | 更大的數據集 | 6355 | 0.9166 | 0.99991 | 點擊下載 |

| EcapaTdnn | spectrogram | 更大的數據集 | 6355 | 0.9154 | 0.99990 | 點擊下載 |

| EcapaTdnn | melspectrogram | 超大的數據集 | 13718 | 0.9179 | 0.99995 | 點擊下載 |

| EcapaTdnn | spectrogram | 超大的數據集 | 13718 | 0.9344 | 0.99995 | 點擊下載 |

安裝環境¶

- 安裝Pytorch的GPU版本,如果已經安裝過Pytorch,無需再次安裝。

pip install torch==1.10.2

- 安裝其他依賴庫,命令如下,注意librosa的版本是0.9.1,舊版本的梅爾頻譜計算方式不一樣。

pip install -r requirements.txt -i https://mirrors.aliyun.com/pypi/simple/

創建數據¶

本教程筆者使用的是中文語音語料數據集 ,這個數據集一共有3242個人的語音數據,有1130000+條語音數據,下載之前要全部解壓數據集。如果讀者有其他更好的數據集,可以混合在一起使用,但最好是要用python的工具模塊aukit處理音頻,降噪和去除靜音。

首先是創建一個數據列表,數據列表的格式爲<語音文件路徑\t語音分類標籤>,創建這個列表主要是方便之後的讀取,也是方便讀取使用其他的語音數據集,語音分類標籤是指說話人的唯一ID,不同的語音數據集,可以通過編寫對應的生成數據列表的函數,把這些數據集都寫在同一個數據列表中。

在create_data.py寫下以下代碼,因爲中文語音語料數據集 這個數據集是mp3格式的,作者發現這種格式讀取速度很慢,所以筆者把全部的mp3格式的音頻轉換爲wav格式,在創建數據列表之後,可能有些數據的是錯誤的,所以我們要檢查一下,將錯誤的數據刪除。執行下面程序完成數據準備。

python create_data.py

執行上面的程序之後,會生成以下的數據格式,如果要自定義數據,參考如下數據列表,前面是音頻的相對路徑,後面的是該音頻對應的說話人的標籤,就跟分類一樣。

dataset/zhvoice/zhmagicdata/5_895/5_895_20170614203758.wav 3238

dataset/zhvoice/zhmagicdata/5_895/5_895_20170614214007.wav 3238

dataset/zhvoice/zhmagicdata/5_941/5_941_20170613151344.wav 3239

dataset/zhvoice/zhmagicdata/5_941/5_941_20170614221329.wav 3239

dataset/zhvoice/zhmagicdata/5_941/5_941_20170616153308.wav 3239

dataset/zhvoice/zhmagicdata/5_968/5_968_20170614162657.wav 3240

dataset/zhvoice/zhmagicdata/5_968/5_968_20170622194003.wav 3240

dataset/zhvoice/zhmagicdata/5_968/5_968_20170707200554.wav 3240

dataset/zhvoice/zhmagicdata/5_970/5_970_20170616000122.wav 3241

訓練模型¶

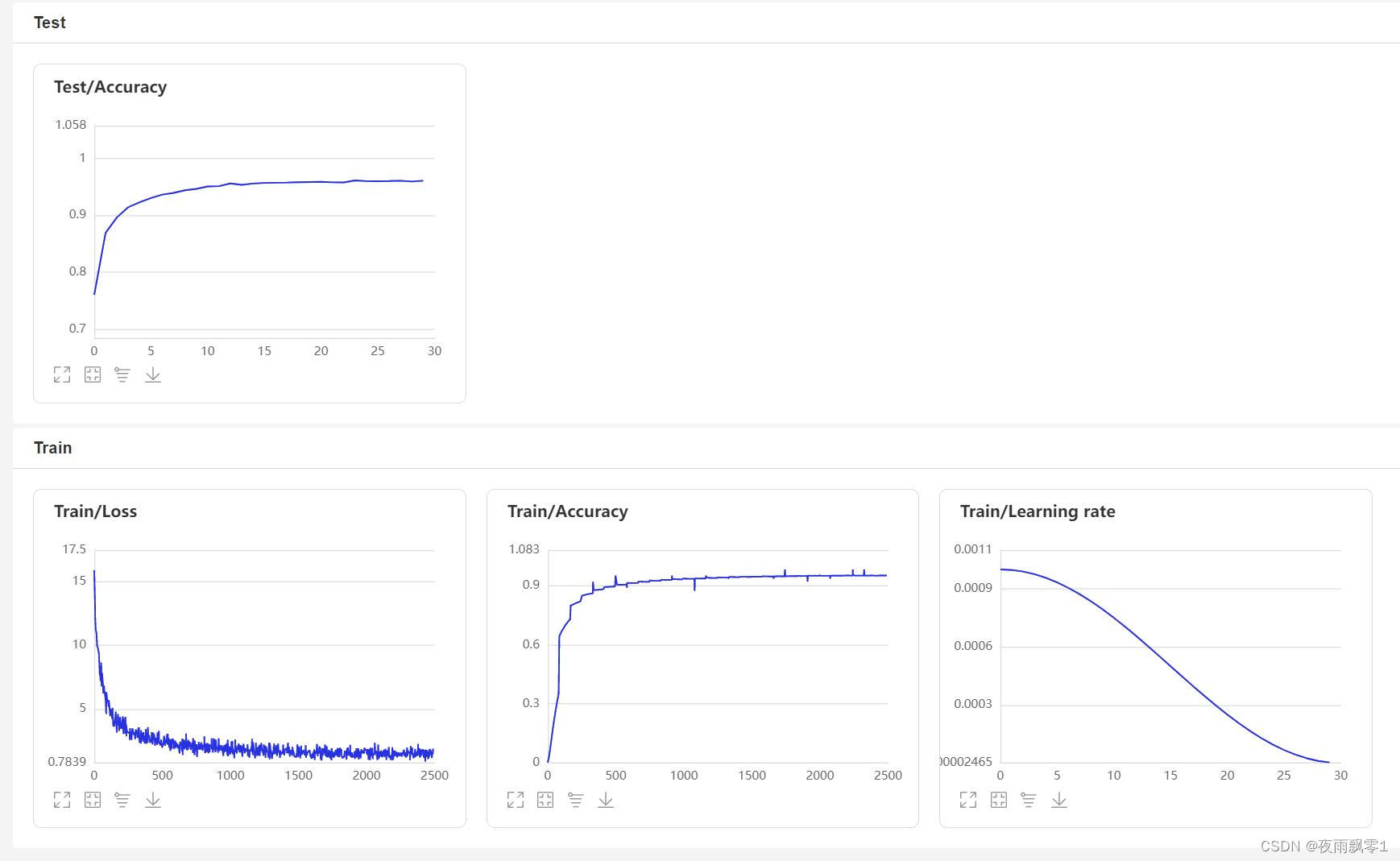

使用train.py訓練模型,本項目支持多個音頻預處理方式,通過參數feature_method可以指定,melspectrogram爲梅爾頻譜,spectrogram爲聲譜圖。通過參數augment_conf_path可以指定數據增強方式。訓練過程中,會使用VisualDL保存訓練日誌,通過啓動VisualDL可以隨時查看訓練結果,啓動命令visualdl --logdir=log --host 0.0.0.0

# 單卡訓練

python train.py

# 多卡訓練

python train.py --gpus=0,1

訓練輸出日誌:

----------- Configuration Arguments -----------

augment_conf_path: configs/augment.yml

batch_size: 64

feature_method: melspectrogram

gpus: 0

learning_rate: 0.001

num_epoch: 30

num_speakers: 3242

num_workers: 4

pretrained_model: None

resume: None

save_model_dir: models/

test_list_path: dataset/test_list.txt

train_list_path: dataset/train_list.txt

use_model: ecapa_tdnn

------------------------------------------------

······

[2022-04-24 09:25:10.481272] Train epoch [0/30], batch: [7500/8290], loss: 9.03724, accuracy: 0.33252, lr: 0.00100000, eta: 14:58:26

[2022-04-24 09:25:32.909873] Train epoch [0/30], batch: [7600/8290], loss: 9.00004, accuracy: 0.33600, lr: 0.00100000, eta: 15:09:07

[2022-04-24 09:25:55.321806] Train epoch [0/30], batch: [7700/8290], loss: 8.96284, accuracy: 0.33950, lr: 0.00100000, eta: 15:13:13

[2022-04-24 09:26:17.836304] Train epoch [0/30], batch: [7800/8290], loss: 8.92626, accuracy: 0.34294, lr: 0.00100000, eta: 14:57:15

[2022-04-24 09:26:40.306800] Train epoch [0/30], batch: [7900/8290], loss: 8.88968, accuracy: 0.34638, lr: 0.00100000, eta: 14:51:06

[2022-04-24 09:27:02.778450] Train epoch [0/30], batch: [8000/8290], loss: 8.85430, accuracy: 0.34964, lr: 0.00100000, eta: 15:00:36

[2022-04-24 09:27:25.240278] Train epoch [0/30], batch: [8100/8290], loss: 8.81858, accuracy: 0.35294, lr: 0.00100000, eta: 14:51:58

[2022-04-24 09:27:47.690570] Train epoch [0/30], batch: [8200/8290], loss: 8.78368, accuracy: 0.35630, lr: 0.00100000, eta: 14:55:41

======================================================================

[2022-04-24 09:28:12.084404] Test 0, accuracy: 0.76057 time: 0:00:04

======================================================================

[2022-04-24 09:28:12.909394] Train epoch [1/30], batch: [0/8290], loss: 5.83753, accuracy: 0.68750, lr: 0.00099453, eta: 2 days, 3:47:48

[2022-04-24 09:28:35.346418] Train epoch [1/30], batch: [100/8290], loss: 5.80430, accuracy: 0.64527, lr: 0.00099453, eta: 15:00:01

[2022-04-24 09:28:57.873686] Train epoch [1/30], batch: [200/8290], loss: 5.78946, accuracy: 0.64218, lr: 0.00099453, eta: 14:46:39

······

VisualDL頁面:

數據增強¶

本項目提供了幾種音頻增強操作,分佈是隨機裁剪,添加背景噪聲,調節語速,調節音量,和SpecAugment。其中後面4種增加的參數可以在configs/augment.yml修改,參數prob是指定該增強操作的概率,如果不想使用該增強方式,可以設置爲0。要主要的是,添加背景噪聲需要把多個噪聲音頻文件存放在dataset/noise,否則會跳過噪聲增強

noise:

min_snr_dB: 10

max_snr_dB: 30

noise_path: "dataset/noise"

prob: 0.5

評估模型¶

訓練結束之後會保存預測模型,我們用預測模型來預測測試集中的音頻特徵,然後使用音頻特徵進行兩兩對比,閾值從0到1,步長爲0.01進行控制,找到最佳的閾值並計算準確率。

python eval.py

輸出類似如下:

----------- Configuration Arguments -----------

feature_method: melspectrogram

list_path: dataset/test_list.txt

num_speakers: 3242

resume: models/

use_model: ecapa_tdnn

------------------------------------------------

W0425 08:27:32.057426 17654 device_context.cc:447] Please NOTE: device: 0, GPU Compute Capability: 7.5, Driver API Version: 11.6, Runtime API Version: 10.2

W0425 08:27:32.065165 17654 device_context.cc:465] device: 0, cuDNN Version: 7.6.

成功加載模型參數和優化方法參數:models/ecapa_tdnn/model.pdparams

開始提取全部的音頻特徵...

167it [00:15, 10.70it/s]

分類準確率爲:0.9608

開始兩兩對比音頻特徵...

100%|███████████████████████████| 5332/5332 [00:05<00:00, 1027.83it/s]

找出最優的閾值和對應的準確率...

100%|███████████████████████████| 100/100 [00:06<00:00, 16.54it/s]

當閾值爲0.58, 兩兩對比準確率最大,準確率爲:0.99980

聲紋對比¶

下面開始實現聲紋對比,創建infer_contrast.py程序,編寫infer()函數,在編寫模型的時候,模型是有兩個輸出的,第一個是模型的分類輸出,第二個是音頻特徵輸出。所以在這裏要輸出的是音頻的特徵值,有了音頻的特徵值就可以做聲紋識別了。我們輸入兩個語音,通過預測函數獲取他們的特徵數據,使用這個特徵數據可以求他們的對角餘弦值,得到的結果可以作爲他們相識度。對於這個相識度的閾值threshold,讀者可以根據自己項目的準確度要求進行修改。

python infer_contrast.py --audio_path1=audio/a_1.wav --audio_path2=audio/b_2.wav

輸出類似如下:

----------- Configuration Arguments -----------

audio_path1: audio/a_1.wav

audio_path2: audio/b_2.wav

feature_method: melspectrogram

resume: models/

threshold: 0.5

use_model: ecapa_tdnn

------------------------------------------------

W0425 08:29:10.006249 21121 device_context.cc:447] Please NOTE: device: 0, GPU Compute Capability: 7.5, Driver API Version: 11.6, Runtime API Version: 10.2

W0425 08:29:10.008555 21121 device_context.cc:465] device: 0, cuDNN Version: 7.6.

成功加載模型參數和優化方法參數:models/ecapa_tdnn/model.pdparams

audio/a_1.wav 和 audio/b_2.wav 不是同一個人,相似度爲:-0.09565544128417969

聲紋識別¶

在上面的聲紋對比的基礎上,我們創建infer_recognition.py實現聲紋識別。同樣是使用上面聲紋對比的infer()預測函數,通過這兩個同樣獲取語音的特徵數據。 不同的是筆者增加了load_audio_db()和register(),以及recognition(),第一個函數是加載聲紋庫中的語音數據,這些音頻就是相當於已經註冊的用戶,他們註冊的語音數據會存放在這裏,如果有用戶需要通過聲紋登錄,就需要拿到用戶的語音和語音庫中的語音進行聲紋對比,如果對比成功,那就相當於登錄成功並且獲取用戶註冊時的信息數據。第二個函數register()其實就是把錄音保存在聲紋庫中,同時獲取該音頻的特徵添加到待對比的數據特徵中。最後recognition()函數中,這個函數就是將輸入的語音和語音庫中的語音一一對比。

有了上面的聲紋識別的函數,讀者可以根據自己項目的需求完成聲紋識別的方式,例如筆者下面提供的是通過錄音來完成聲紋識別。首先必須要加載語音庫中的語音,語音庫文件夾爲audio_db,然後用戶回車後錄音3秒鐘,然後程序會自動錄音,並使用錄音到的音頻進行聲紋識別,去匹配語音庫中的語音,獲取用戶的信息。通過這樣方式,讀者也可以修改成通過服務請求的方式完成聲紋識別,例如提供一個API供APP調用,用戶在APP上通過聲紋登錄時,把錄音到的語音發送到後端完成聲紋識別,再把結果返回給APP,前提是用戶已經使用語音註冊,併成功把語音數據存放在audio_db文件夾中。

python infer_recognition.py

輸出類似如下:

----------- Configuration Arguments -----------

audio_db: audio_db

feature_method: melspectrogram

resume: models/

threshold: 0.5

use_model: ecapa_tdnn

------------------------------------------------

W0425 08:30:13.257884 23889 device_context.cc:447] Please NOTE: device: 0, GPU Compute Capability: 7.5, Driver API Version: 11.6, Runtime API Version: 10.2

W0425 08:30:13.260191 23889 device_context.cc:465] device: 0, cuDNN Version: 7.6.

成功加載模型參數和優化方法參數:models/ecapa_tdnn/model.pdparams

Loaded 沙瑞金 audio.

Loaded 李達康 audio.

請選擇功能,0爲註冊音頻到聲紋庫,1爲執行聲紋識別:0

按下回車鍵開機錄音,錄音3秒中:

開始錄音......

錄音已結束!

請輸入該音頻用戶的名稱:夜雨飄零

請選擇功能,0爲註冊音頻到聲紋庫,1爲執行聲紋識別:1

按下回車鍵開機錄音,錄音3秒中:

開始錄音......

錄音已結束!

識別說話的爲:夜雨飄零,相似度爲:0.920434

其他版本¶

- Tensorflow:VoiceprintRecognition-Tensorflow

- PaddlePaddle:VoiceprintRecognition-PaddlePaddle

- Keras:VoiceprintRecognition-Keras

參考資料¶

- https://github.com/PaddlePaddle/PaddleSpeech

- https://github.com/yeyupiaoling/PaddlePaddle-MobileFaceNets

- https://github.com/yeyupiaoling/PPASR